Fine-tuning языковых моделей под специфику бизнеса: когда это нужно и как делать

Мария Балаклеева

Директор по развитию

Ваш техдир заплатил за корпоративный доступ к GPT-5.5, команда интегрировала API — и через месяц выясняется: модель не понимает внутренний сленг, путает номенклатуру продуктов, выдаёт юридически рискованные формулировки. Универсальная модель натренирована на всём интернете, но не на вашей специфике. Fine-tuning реша�ет проблему, но стоит времени и денег — и нужен не всегда. Разберёмся, когда дообучение оправданно, какие методы существуют и как не слить бюджет на переобучение.

Что такое fine-tuning и чем он отличается от обычного использования ИИ

Fine-tuning — это дообучение предтренированной языковой модели на ваших данных, чтобы она понимала контекст бизнеса. Базовые модели вроде GPT или LLaMA обучены на петабайтах общих текстов — новостях, книгах, форумах. Они умеют писать, переводить, отвечать на вопросы. Но если вы спросите у GPT-4 про специфичный термин вашей отрасли или попросите составить договор с учётом внутренних регламентов — получите усреднённый ответ, который придётся переделывать.

Обычное использование API — это zero-shot или few-shot промптинг: вы подаёте запрос, иногда с примерами в промпте, и получаете результат. Модель работает «как есть». Fine-tuning идёт глубже: вы берёте базовую модель и дотренируете её на сотнях или тысячах примеров — диалогах техподдержки, юридических документах, архиве заказов. Модель подстраивает веса нейросети под ваши паттерны. Результат — она начинает «говорить на вашем языке», меньше ошибается в терминах и следует корпоративному стилю.

Разница как между универсальной CRM и кастомной разработкой. Первое работает из коробки, второе — только после настройки под процессы.

Когда бизнесу действительно нужен fine-tuning модели

Не каждой задаче нужна дообученная модель. Если вы автоматизируете базовую техподдержку с типовыми вопросами — хватит грамотного промпта и RAG (retrieval-augmented generation), когда модель ищет ответы в вашей базе знаний. Fine-tuning оправдан в трёх случаях.

Первый: у вас узкая предметная область со специфичной терминологией. Медицинская компания, которая обрабатывает выписки врачей. Юридическая фирма с базой договоров. E-commerce с тысячами SKU и внутренними кодами. Базовая модель такие данные не видела — будет галлюцинировать.

Второй: нужен �контроль тональности и стиля. Банк не может позволить боту писать клиентам в стиле Reddit. Дообученная модель выучит корпоративный тон, форматы ответов, юридически безопасные формулировки.

Третий: высокая частота повторяющихся задач. Если вы обрабатываете 10 000 запросов в день, даже 5% улучшение точности экономит десятки человеко-часов.

Пример из практики: AI-платформа, где физлица и компании получают ответы от нейросетей. Задача стояла реализовать кроссплатформенный интерфейс и интегрировать несколько моделей. Ключевой вызов — обеспечить релевантные ответы для бизнес-пользователей, которые задают вопросы с отраслевой спецификой. Без fine-tuning под корпоративные примеры модель выдавала общие ответы, которые не закрывали реальные потребности клиентов. Дообучение на датасете реальных запросов сократило количество «пустых» ответов и увеличило пользовательскую удовлетворённость.

Если ваша задача решается промптом или внешней базой знаний — не тратьте ресурсы. Fine-tuning — не магия, а инструмент для конкретных проблем.

Методы fine-tuning: от простого дообучения до полной адаптации

Существует несколько подходов к дообучению. Выбор зависит от объёма данных, бюджета и требований к точности.

Full fine-tuning — классический метод: вы берёте предобученную модель и дотренируете все её слои на вашем датасете. Это даёт максимальную адаптацию, но требует мощных GPU, недель вычислений и риска переобучения. Подходит, если у вас сотни тысяч размеченных примеров и критичная специфика — например, обучение модели для анализа медицинских снимков с текстовыми описаниями.

Parameter-Efficient Fine-Tuning (PEFT) — лёгкий вариант. Вы замораживаете основные слои модели и дотренируете только малую часть параметров. Популярный метод — LoRA (Low-Rank Adaptation): в модель добавляются маленькие адаптеры, которые обучаются на ваших данных. Экономия ресурсов в 10–100 раз, скорость выше, качество близко к full fine-tuning. Это золотая середина для большинства корпоративных задач.

Instruction tuning — дообучение на парах «инструкция-ответ». Вы даёте модели примеры: «Составь договор на аренду офиса» → пример договора. Модель учится следовать командам в вашем формате. Хорошо работает для ассистентов, чат-ботов, автоматизации документооборота.

Instruction tuning быстрее внедряется, но требует качественной разметки. LoRA — компромисс между скоростью и качеством. Full fine-tuning — если у вас есть ML-команда и бюджет.

Пошаговый процесс fine-tuning для корпоративных задач

Процесс дообучения — это не «загрузил данные и нажал кнопку». Ошибка на любом этапе = потеря времени и денег.

Шаг 1: сбор и подготовка данных. Нужен датасет из 500–10 000 примеров, в зависимости от сложности задачи. Это могут быть диалоги техподдержки, архив писем, транскрипты звонков. Главное — данные должны быть размечены и очищены. Если в диалогах клиенты матерятся, а операторы копируют шаблоны — модель выучит это. Разметка — самая долгая часть. Юристы, аналитики, домен-эксперты проверяют каждый пример.

Шаг 2: выбор базовой модели. Если данные на русском — берите ruGPT, YaLM, GigaChat или мультиязычные модели вроде LLaMA с хорошей поддержкой кириллицы. Если задача узкая — можно взять модель меньше (7–13B параметров), она быстрее и дешевле в инференсе.

Шаг 3: дообучение с валидацией. Разделите данные на train/validation/test. Дообучайте на train, проверяйте качество на validation, чтобы отловить переобучение. Метрики: perplexity (насколько уверенно модель предсказывает текст), BLEU/ROUGE (для генерации), F1 (для классификации). Тренировка занимает от нескольких часов до недель, в зависимости от объёма данных и железа.

Шаг 4: тестирование на реальных задачах. Прогоните модель по тестовому набору и дайте домен-экспертам оценить результаты. Если модель выдаёт 95% корректных ответов, но 5% — юридически опасные — это провал. Лучше меньше автоматизации, чем репутационный риск.

Шаг 5: развёртывание и мониторинг. Разверните модель через API или on-premise. Следите за качеством ответов, собирайте обратную связь. Модель может деградировать, если реальные запросы начнут отличаться от тренировочных данных. Периодически дообучайте на новых примерах.

Один цикл занимает от месяца (простая задача, готовый датасет) до полугода (сложная разметка, эксперименты с архитектурой).

Типичные ошибки и как избежать переобучения модели

Ошибка №1: слишком мало данных. Дообучение на 50 примерах — это не fine-tuning, а лотерея. Модель запомнит примеры наизусть, но не обобщит паттерны. Минимум — 500–1000 к�ачественных примеров. Если данных мало — используйте data augmentation (синтетическая генерация похожих примеров) или возвращайтесь к few-shot промптингу.

Ошибка №2: переобучение (overfitting). Модель идеально работает на тренировочных данных, но проваливается на новых запросах. Причина — слишком много эпох обучения, маленький датасет или отсутствие регуляризации. Решение: early stopping (останавливайте тренировку, когда метрики на validation перестают улучшаться), dropout, увеличение датасета.

Ошибка №3: игнорирование смещения. Если ваш датасет состоит из диалогов только одного отдела или региона, модель не поймёт запросы из других контекстов. Проверяйте репрезентативность данных. Если обучаете модель на юридических документах — включите разные типы договоров, юрисдикции, форматы.

Ошибка №4: отсутствие версионирования. Вы дообучили модель, развернули — и через неделю поняли, что старая работала лучше. Без системы версионирования (MLflow, DVC) вернуться к предыдущей версии сложно. Храните чекпоинты, логируйте метрики, документируйте изменения.

Ошибка №5: недооценка инфраструктуры. Fine-tuned модель требует больше ресурсов для инференса, чем API-запросы к облачной модели. Если вы дообучили LLaMA-13B, а у вас нет GPU для хостинга — получите задержки в секунды, что убьёт пользовательский опыт. Планируйте инфраструктуру до старта.

Частые вопросы о fine-tuning языковых моделей

Сколько стоит дообучить модель?

От 200 тыс. до нескольких млн рублей. Зависит от объёма данных, сложности разметки, метода дообучения и инфраструктуры. Если данные уже размечены и используете LoRA на облачных GPU — около 300–500 тыс. рублей. Если нужно разметить 10 000 примеров силами экспертов и тренировать full fine-tuning — миллионы и месяцы.

Можно ли дообучить модель на конфиденциальных данных?

Да, если разворачиваете модель on-premise или в приватном облаке. Публичные API (OpenAI, Anthropic) предлагают fine-tuning, но данные передаются провайдеру. Для банков, медицины, гособоронзаказа — только локальное решение.

Как часто нужно дообучать модель?

Зависит от динамики данных. Если ваша предметная область стабильна (юридические шаблоны, технические мануалы) — раз в полгода-год. Если быстро меняется (новости, маркетинг, e-commerce с новыми продуктами) — ежемесячно или квартально.

Fine-tuning или RAG?

RAG (retrieval-augmented generation) дешевле и быстрее: модель ищет ответы в вашей базе знаний и генерирует ответ на их основе. Подходит, если данные структурированы и часто обновляются. Fine-tuning лучше, если нужна адаптация стиля, тона, специфичной терминологии или данные неструктурированы. Часто используют оба подхода вместе.

Fine-tuning ��— не волшебная кнопка, а инженерная задача с чёткими требованиями к данным, инфраструктуре и экспертизе. Если у вас есть 1000+ качественных примеров, специфика, которую не закрывает базовая модель, и бюджет на ML-команду — дообучение окупится. Если нет — начните с промптов и RAG, соберите данные, оцените реальную потребность. Главное — не дообучать модель ради модности технологии, а решать конкретную бизнес-проблему.

Наши публикации

AI-агенты: что это и как они могут увеличить прибыль вашей компании

Объясняем простыми словами, что такое AI-агенты и как их внедрить в бизнес. Примеры использования, плюсы и риски автоматизации.

ИИ-агенты в работе 2026: от экспериментов к автономным бизнес-процессам

Узнайте, как внедрить автономных ИИ-агентов. Разбираем микросервисную архитектуру, интеграцию с SAP/CRM и методологию масштабирования от экспертов Fortech.

Примеры работ

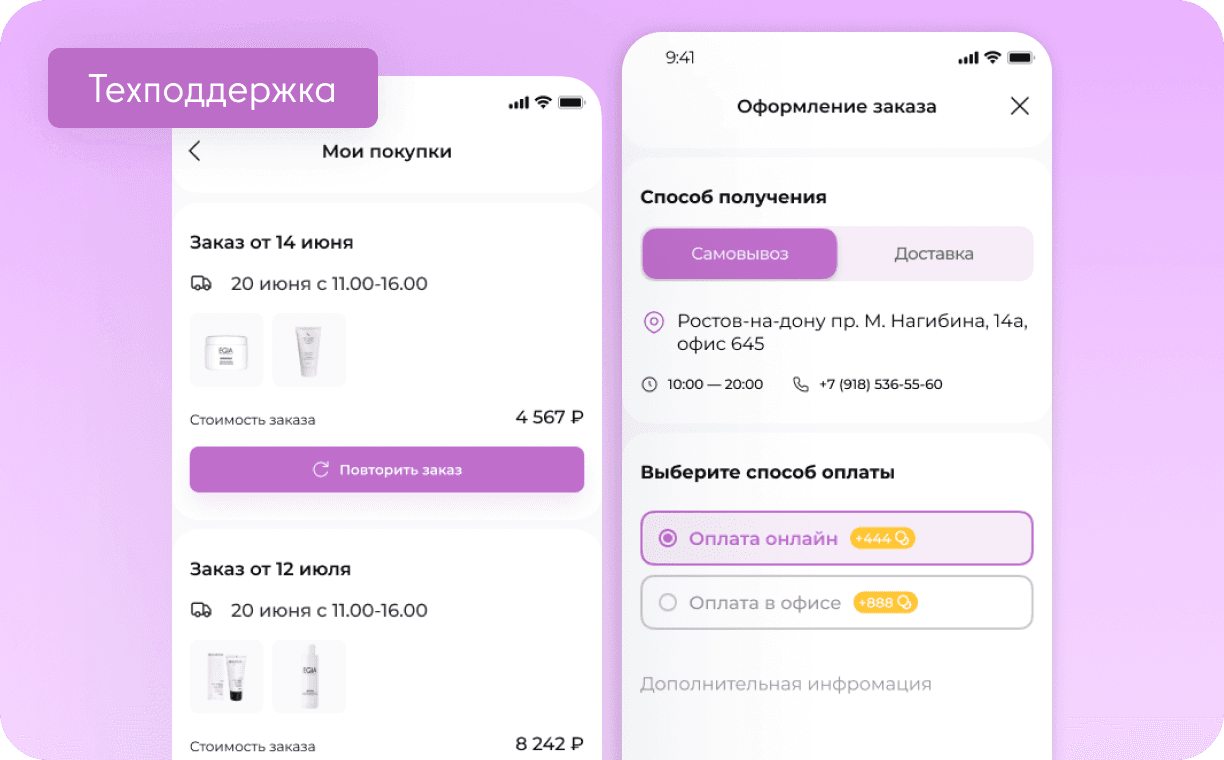

Техподдержка и развитие платформы FILARAcosmo

от диагностики медленных запросов до интеграции с 1С и ЮKassa. Опыт внедрения Prometheus/Grafana, оптимизации потребления памяти и реализации нового функционала в рамках SLA.

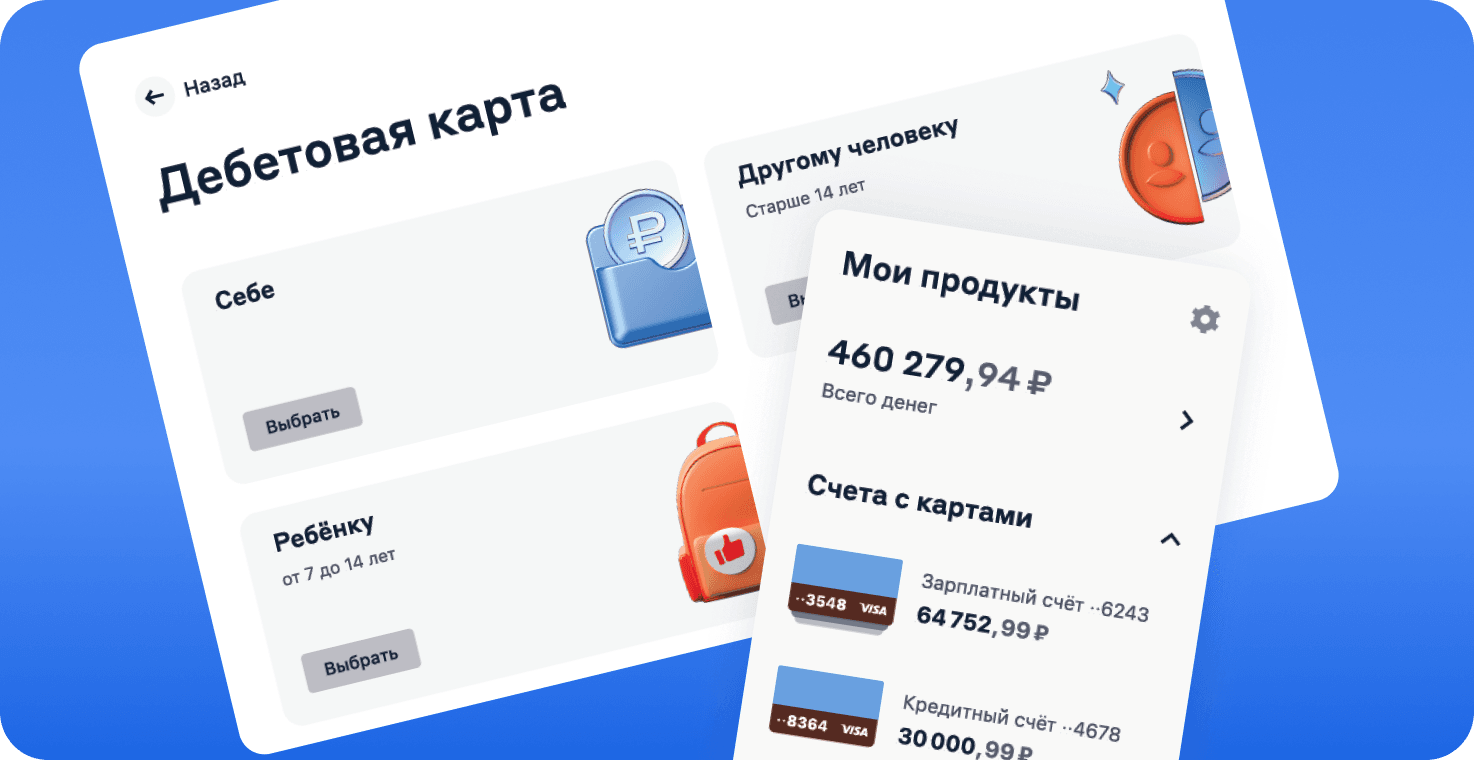

Сервис онлайн-оформления банковских карт

Веб-приложение для� управления счетами и заказа карт — включая детские и на третьих лиц